Temps de lecture : 6 minutes

Rencontrer une personne en chair et en os, bientôt la nouvelle norme ? “La perte de visibilité de ce qui est réel et généré par IA” constitue un risque pour 43% des personnes interrogées lors d’une étude Ipsos intitulée “L’usage de l’intelligence artificielle par les Français”. Annoncée comme la plus grande invention depuis Internet, la révolution de l’image générée par intelligence artificielle nous concerne tous. Qu’elles soient conçues de toute pièce ou détournées en reprenant le visage d’une personnalité (deepfake), les images trafiquées à l’aide de l’IA ont le plus souvent vocation à tromper l’internaute.

Votre vidéo n'est pas affichée car vous avez refusé les cookies.

En cybersécurité, le meilleur antivirus, c’est vous. Il en va de même pour la détection des contenus factices : il n’existe pas d’outils 100% fiable. Alors pour ne pas vous faire avoir, on vous propose de jouer au jeu des 7 différences version 3.0.

1. Etrange anatomie

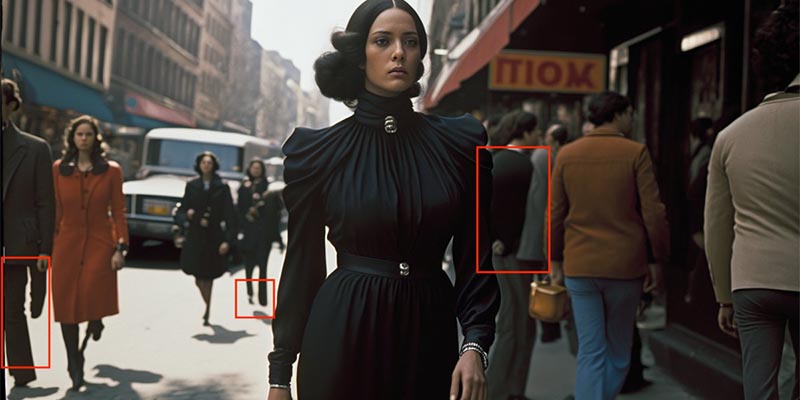

Le temps des mains à six doigts semble révolu. La qualité des images créées avec l'aide des IA s'est nettement améliorée depuis les premiers générateurs d'images accessibles au grand public tels que DALL-E, Midjourney ou Stable Diffusion. Cependant, des anomalies visuelles persistent dans la représentation de l'anatomie. Sortez donc votre œil de lynx pour les traquer au niveau des oreilles (leur forme, bizarre), des yeux (asymétriques, parfois), des dents ou encore à arrière-plan, où les personnages ont un visage flou et des proportions bizarres.

Enfin, prêtez attention à un grain de peau trop lisse et brillant ou encore à la position parfois improbable des corps, dont les proportions peuvent être discutables.

2. Incohérences physiques et anachroniques

Vous avez déjà joué à “Où est Charlie” ? Eh bien là, plutôt que de chercher le petit bonhomme aux lunettes rondes, vous allez chercher les détails les plus absurdes de la “photographie”.

- Les couleurs : parfois les couleurs ne s’accordent pas vraiment et donnent une impression de collage.

- Les couvre-chefs : les couvre-chefs sont placés de façon totalement aléatoire sur les personnages d’une “photo”. L’intelligence artificielle a encore du mal à comprendre la logique et la fonction de nos chapeaux adorés.

- Les objets : encore une fois la relation entre l’objet et sa fonction échappe parfois à l’IA et ça donne des résultats plutôt surprenants visuellement… Confondez-la sur ces points !

Exemples : Sur cette “photo” du tournage de la mission Apollo 11 générée par Midjourney, on constate que l’un des astronautes porte… une casquette.

Admirez comme la loupe tient miraculeusement dans la patte de notre faux chat fabriqué par Dall-E.

Enfin, certains tentent de faire rimer Belle Epoque avec smartphone…

Votre vidéo n'est pas affichée car vous avez refusé les cookies.

Laissez-vous guider par votre bon sens dans ces cas-là.

3. Utilisation d’un détecteur

Depuis plusieurs années, des géants de la tech comme Microsoft et Intel, travaillent sur la reconnaissance des images générées par IA via des outils de détection. Bien qu'aucun ne soit infaillible, ils constituent une aide précieuse. En voici une sélection :

- Azure : cet outil de détection créé par Microsoft fournit un score de confiance indiquant avec précision le taux de probabilité de manipulation.

- Sensity : fonctionnant comme un antivirus, la plateforme propose un logiciel qui détecte les médias falsifiés. Si l’utilisateur est face à un deepfake, il reçoit automatiquement un e-mail d’alerte.

- Deep Fake Detector : l'extension de Mozilla qui permet de détecter les contenus générés par IA sur Firefox.

Conscient des imperfections de ces détecteurs, l’Etat a lancé en marge du Sommet sur l’IA un appel à collaborations auprès du grand public afin de créer un "méta-détecteur" de contenus générés par IA. Basé sur le modèle collaboratif de logiciel en open source (chacun peut contribuer en fonction de son expertise à la rédaction de quelques lignes de code) ce projet rassemble les compétences de chacun sur une page qui reste accessible à tous à des fins de commentaire ou de modification.

Bonus : Amusez-vous à reconnaître les vrais visages de ceux fabriqués par une intelligence artificielle avec le jeu “Which Face Is Real” (“Quel est le vrai visage ?” en anglais)

4. Mentions spéciales apparentes

Depuis février 2024, Meta (la maison mère de Facebook, Instagram et WhatsApp) affiche la mention “généré par une IA” ou “Image contenant des éléments créés par une intelligence artificielle” sur les publications concernées. Ce modèle d’étiquetage repose sur de la détection automatique et des signalements d'utilisateurs. Sur TikTok, ce sont les créateurs eux-mêmes qui doivent mentionner qu'une IA a été utilisée, si l'image a "une apparence réaliste", selon le règlement de la plateforme.

Autrement dit, ce n'est pas parce que la mention "généré par IA" n'apparaît pas que l'image est nécessairement authentique, précise Franceinfo. Cependant, Instagram ne discerne pas le vrai du faux à coup sûr. Le logiciel de la plateforme a déjà identifié une image comme étant générée par IA alors que ce n’était pas le cas. Le photographe Peter Yan en a fait les frais pour avoir simplement "nettoyé" quelques tâches indésirables avec Photoshop. “Si un outil d’édition photo utilise l’IA pour changer la taille ou la couleur d’une image, cette image comportera probablement un signal indiquant qu’elle a été modifiée au moyen de l’IA. Ces signaux sont lus par les systèmes de Meta pour déterminer si le contenu nécessite une étiquette”, peut-on lire sur le site de la firme américaine.

5. Vérification des sources et signalement

Dernier conseil, valable pour les images générées par des IA comme pour toutes les autres d’ailleurs. Pour attester de la fiabilité d’une photo, il faut commencer par vérifier sa source. En ce qui concerne les “photographies” créées par IA, vérifier si le crédit photo (sa source) figure en petit caractère sous l’image. Ou, si elle a été postée sur les réseaux sociaux, s’il figure en légende ou en commentaire, sous la publication.

Si vous tombez sur ce qui semble être un deepfake, signalez-le à la plateforme hébergeant le contenu. Les signalements des utilisateurs jouent un rôle crucial pour aider les plateformes à identifier et à prendre des mesures contre les médias trompeurs.

Comme le dit Grégory Chatonsky, qui observe les usages de l’IA depuis 1996 dans l’émission Le Dessous des Images, ”une image n’a jamais été preuve de la réalité”.

Votre vidéo n'est pas affichée car vous avez refusé les cookies.

La clé reste la vigilance et le croisement des sources, particulièrement pour les images à caractère sensationnel ou celles qui semblent trop parfaites pour être vraies.